KI-Cluster für unterschiedlichste Zielgruppen

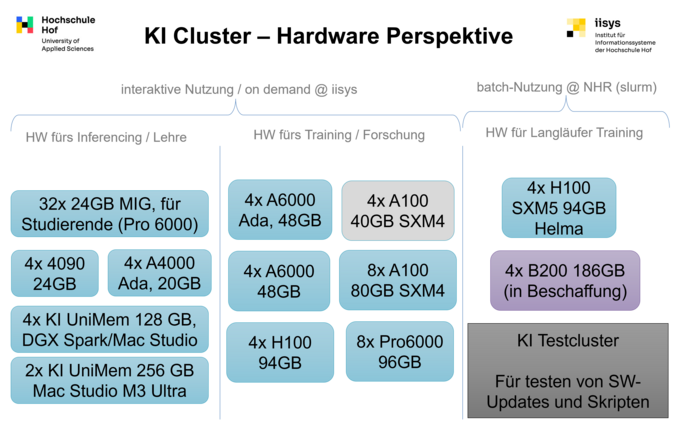

Das Institut für Informationssysteme betreibt in Kooperation mit der Fakultät Informatik einen KI-Cluster, in dem Studierende, Forschende, Lehrende und die Verwaltung auf Hard- und Software-Ressourcen für KI-Anwendungen zurückgreifen kann. Wir unterscheiden dabei zwischen Systemen, die für Lehre und Inferencing, also den Betrieb von KI-Modellen wie dem Chatbot LISA und dem Bildgenerator LUIS eingesetzt werden, und Systemen für die Forschung zu KI und damit insb. das Training neuer oder die Spezialisierung bestehender KI-Modelle. Für die Lehre stellen wir den Studiengruppen der Informatik Fakultät Teile einer großen Grafikkarte (GPU) für das ausführen und trainieren eigener Modelle zur Verfügung, sog. MIGs. Diese sind aktuell 24 GB groß und reichen damit auch für größere KI Modelle bis 30 Mrd. Parameter für das Inferencing oder bis ca. 12 Mrd. Parameter für das Training / Finetuning. Für die Forschung haben wir selbst erhebliche Ressourcen vor Ort, die insb. für den interaktiven Betrieb (ich brauche mal schnell eine Grafikkarte fürs Testen eines neuen Modells) und kürzer laufende Trainings gedacht sind und weiteren Systemen, die von der Hochschule Hof finanziert wurden, aber in einen größeren Rechencluster bei der FAU Erlangen Nürnberg im NHR Höchstleistungsrechenzentrum stehen und dort betrieben werden.

Letztere sind für länger laufende Trainings über mehrere Wochen ideal. Dort können wir nicht nur auf das eine bestehende und zweite in Beschaffung befindliche System zugreifen, sondern bei Bedarf für einzelne Trainings für einige Zeit auch mal 16 oder 32 GPUs auf einmal nutzen, solange das übers Jahr verteilt im Rechenbudget der Hochschule bleibt.

Verfügbare KI-Modelle

Ressourceneffizienz ist uns wichtig. Daher betreiben wir fast ausschließlich quantisierte KI-Modelle, die nur ein Viertel der ursprünglichen Größe haben und daher auch deutlich weniger Rechenleistung und damit Energie verbrauchen, aber dafür geringfügig an Genauigkeit verlieren. Zusätzlich setzen wir nicht nur die typische Rechenzentrums-Hardware von Nvidia ein, sondern punktuell auch extra energie-sparende Spezialtechnik aus dem Consumer-Bereich wie DGX Spark und Mac Studio

Wir betreiben eigene Chatbots und Bildgeneratoren für verschiedene Anwendungsbereiche, die typischerweise einmal pro Semester aktualisiert werden, um auf dem aktuellen Stand der Technik zu bleiben. Während wir im Herbst 2023 noch mit einem Mistral 7B Modell gestartet sind, haben wir uns im Laufe der Zeit über ein Llama 3.3 70B bis hin zum Qwen 3 235B Modell im Wintersemester 2025/26 verbessert. Aktuell evaluieren wir Minimax M2.1, Step 3.5 Flash sowie GLM 4.7 Flash und Devstral 2 für Coding Aufgaben. Unser Bildgenerator wird von einem Qwen Image Edit 2509 Lightning angetrieben.